Kurzfassung: Viele Website‑Betreiber beobachten 2026 ein Paradox: Die Sichtbarkeit in den Suchergebnissen steigt, die Klickrate hingegen fällt. Studien von SISTRIX und Befunde des Pew Research Center machen AI Overviews und veränderte Nutzergewohnheiten als zentrale Treiber aus. Für Publisher, Marken und SEO‑Teams bedeutet das: Sichtbarkeit allein reicht nicht mehr, es braucht neue Messgrößen und Anpassungen an die veränderte Suchintention.

Warum Klickrate und Sichtbarkeit zunehmend entkoppelt sind

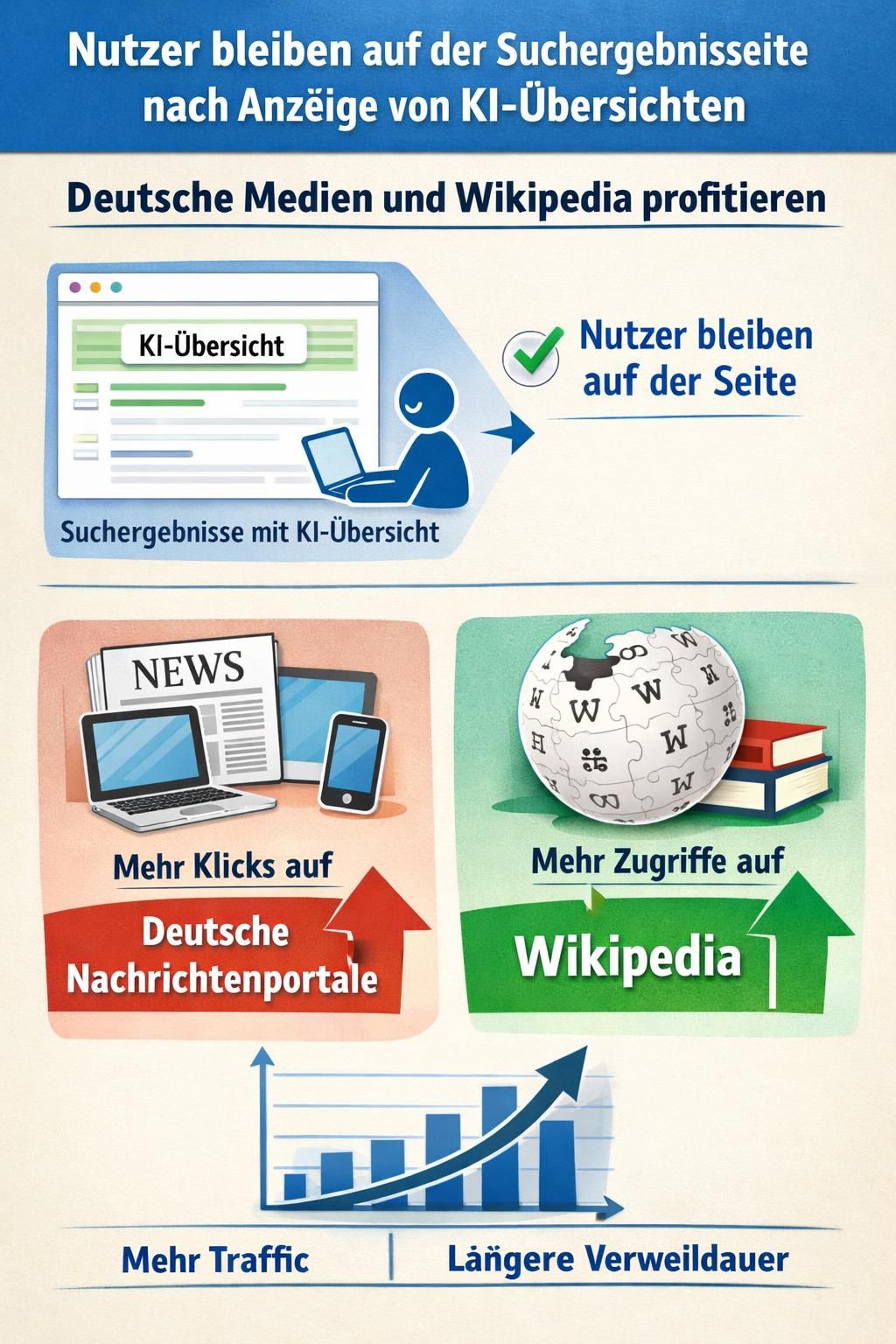

Die wichtigste Nachricht: Wenn Suchmaschinen KI‑Zusammenfassungen oberhalb klassischer Treffer einblenden, sinkt die Wahrscheinlichkeit, dass Nutzer auf externe Links klicken. Untersuchungen zeigen, dass die Klickwahrscheinlichkeit bei aktiven AI‑Antworten um rund 50 % fallen kann.

Daten, Akteure und direkte Folgen

Als zentrale Akteure treten Google, Analysefirmen wie SISTRIX und Forschungseinrichtungen wie das Pew Research Center auf. SISTRIX dokumentierte Millionen von AI‑Summaries und einen deutlichen Verschiebungseffekt zugunsten vertrauenswürdiger Domains wie Wikipedia und öffentlich‑rechtlicher Medien. Die Folge ist ein sichtbarer Verlust an organischem Traffic und damit an potenziellen Leads und Conversion.

Für ein regionales deutsches Nachrichtenportal, das ich hier als Beispiel verfolge, bedeutet das konkret: Mehr Impressionen in der Search Console, aber weniger Besucher auf der Webseite — und damit sinkende Anzeigenumsätze und Abonnentenanfragen.

Dieser Befund legt nahe, dass klassische SEO‑Erfolge nicht automatisch in Engagement übersetzt werden — das ändert die Spielregeln für Content‑Strategien.

Technische Ursachen: Ranking, Core Web Vitals und Tracking‑Fallstricke

Ein sinkendes Ranking trotz gestiegener Klickzahlen kann technische Gründe haben. Indexierungsfehler, langsame Ladezeiten oder fehlerhafte Weiterleitungen beeinflussen die Bewertung durch Suchmaschinen nachhaltig.

Kontext, Tools und messbare Effekte

Suchmaschinen bewerten heute neben Relevanz auch die Page Experience. Metriken wie Largest Contentful Paint oder Cumulative Layout Shift bestimmen, wie Suchmaschinen Nutzererfahrung einordnen. Tools wie Google Search Console, PageSpeed Insights, Ahrefs oder SEMrush helfen, Probleme sichtbar zu machen.

Gleichzeitig führt fehlerhafte Implementierung von Tracking‑Skripten zu Diskrepanzen zwischen Impressionen, Klicks und internen Analytics. Ein Publisher, der plötzlich steigende Klickzahlen meldet, sollte deshalb die Datenqualität prüfen: Bot‑Traffic, Doppeltracking oder verzögerte Datenverarbeitung können Zahlen verzerren.

Pragmatische Einsicht: Technische Sauberkeit ist die Grundlage, damit erhöhter Traffic auch zu stabilen Rankings und besseren Conversion-Raten führt.

Strategien für 2026: Von SEO zu AI Visibility und Anpassung an das Nutzerverhalten

Publisher und Marken müssen ihre Inhalte so gestalten, dass sie sowohl für Menschen als auch für KI‑Systeme verwertbar sind. Das reicht von strukturieren Metadaten bis zu klaren Autorenangaben und aktuell gepflegten Fakten.

Praktische Maßnahmen, Akteure und Auswirkungen auf Monetarisierung

Maßnahmen umfassen strukturierte Daten, E‑A‑T‑orientierte Inhalte und semantische Themencluster — siehe etwa Hinweise zu Content‑Clustern für bessere Auffindbarkeit auf arbeitzwonull.de. Für Geschäftsmodelle ist wichtig, wie sich Sichtbarkeit in direkte Einnahmen wandelt; detaillierte Diskussionen zur Monetarisierung online zeigen Handlungsspielräume für Verlage.

Wer es schafft, als zuverlässige Quelle in AI‑Zusammenfassungen genannt zu werden, gewinnt langfristig an Autorität. Wer das nicht schafft, muss alternative Kanäle stärken: Newsletter, Direct Traffic und Partnerschaften bleiben wichtige Hebel.

Abschließender Insight: Die Messlatte verlagert sich von reiner Sichtbarkeit hin zu Qualität, Kontext und Vertrauenswürdigkeit — wer das früh adressiert, sichert Traffic, Conversion und langfristiges Wachstum.

Ausblick: Die Debatte um Attribution, Fairness und regulatorische Eingriffe in die Nutzung fremder Inhalte durch KI‑Overviews wird 2026 weitergehen. Für Unternehmen gilt jetzt, technische Stabilität, inhaltliche Tiefe und klare Quellenpflege zu priorisieren, um in der neuen Suchlandschaft sichtbar und wirtschaftlich tragfähig zu bleiben.