Redaktionen, Marketingteams und Plattformbetreiber überarbeiten 2026 ihre Content-Standards, um mit der Verbreitung von KI-generierten Texten Schritt zu halten. Große Sprachmodelle wie ChatGPT, Gemini und Claude liefern heute in Sekunden Entwürfe, während Verlage und Unternehmen stärker auf Redaktionsrichtlinien, Plagiaterkennung und rechtliche Prüfungen setzen. Diese Anpassung betrifft Textqualität, Automatisierung und die Verantwortung für Informationsverbreitung.

Warum Medien und Unternehmen ihre Redaktionsrichtlinien für KI neu schreiben

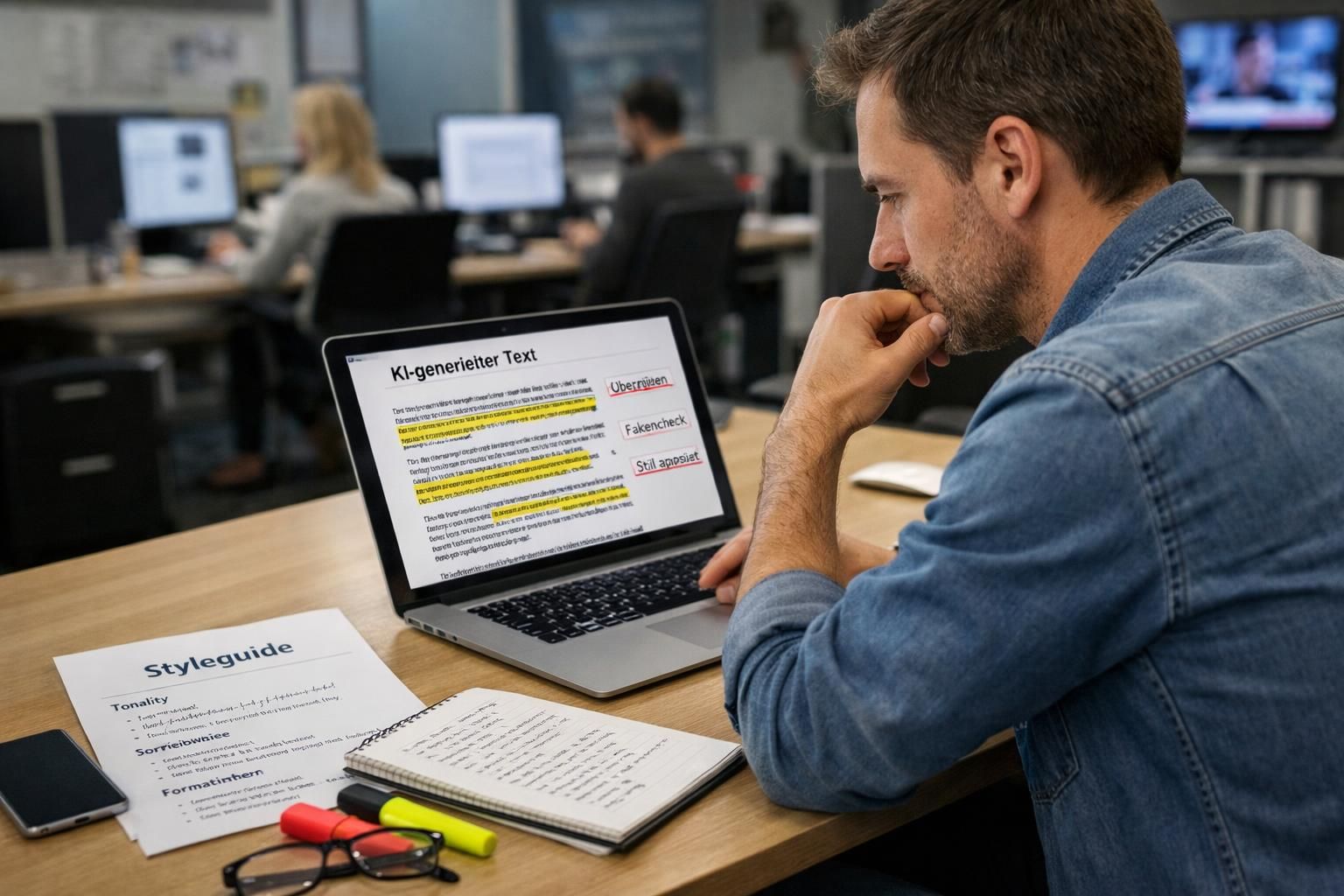

Praktische Veränderungen im Arbeitsalltag

Viele Newsrooms und Marketingabteilungen nutzen künstliche Intelligenz inzwischen als Tool für Ideen, Rohentwürfe oder Bulk-Content wie Produkttexte. Das führt zu höherer Effizienz und spürbarer Automatisierung von Routineaufgaben.

Gleichzeitig sehen Verantwortliche die Notwendigkeit, formelle Redaktionsrichtlinien zu definieren: wer das KI-Ergebnis prüft, welche Quellen verbindlich sind und wie KI-generierte Texte zu kennzeichnen sind. Für mittelgroße Redaktionen in der DACH-Region ist das eine Frage der Glaubwürdigkeit und Rechtsicherheit.

Damit entsteht ein neues Produktionsmodell: Maschinen liefern Tempo, Menschen sichern Haltung und Kontext. Diese Balance wird zum Kern aktueller Content-Standards.

Wie Textqualität, Glaubwürdigkeit und technische Grenzen zusammenspielen

Risiken: Halluzinationen, Oberflächlichkeit und Plagiat

Sprachmodelle erzeugen plausible Formulierungen, aber nicht immer verifizierbare Fakten. Fachartikel, medizinische oder juristische Inhalte bleiben besonders anfällig für Fehler. Redaktionelle Endkontrollen sind deshalb unverzichtbar.

Ein weiteres Problem ist die Plagiaterkennung. KI-Modelle schöpfen aus großen Datenbeständen; Formulierungen können ähnlich oder identisch zu bestehenden Texten werden. Das erhöht das Risiko für Duplicate Content und rechtliche Konflikte, gerade wenn Inhalte ohne Prüfung veröffentlicht werden.

SEO und Sichtbarkeit in Suchmaschinen

Suchmaschinen wie Google bewerten Qualität und Nutzerintention. Automatisiert erzeugte Inhalte können kurzfristig Sichtbarkeit bringen, langfristig aber durch Thin Content oder Keyword-Stuffing abgestraft werden. Commerce-Teams nutzen KI gern für standardisierte Produkttexte, müssen diese aber für Originalität und Mehrwert nachbearbeiten.

Die Praxis zeigt: KI ist ein Beschleuniger, aber keine Garantie für qualitative Inhalte. Qualitätskontrolle bleibt die zentrale Redaktionsaufgabe.

Regeln, Ethik und die Rolle der Medieninnovation für die Informationsverbreitung

Rechtliche Rahmenbedingungen und Datenschutz

Datenschutzfragen sind relevant, wenn personenbezogene Daten in Prompts verwendet werden. Behörden wie das deutsche Bundesministerium des Innern warnen davor, sensible Daten ungeschützt an externe Dienste zu übermitteln. Das betrifft sowohl GDPR-Konformität als auch vertragliche Vereinbarungen mit KI-Anbietern.

Urheberrechtliche Fragen bleiben offen: Reine KI-Produkte gelten nicht zwingend als schutzfähige Werke, sodass Exklusivität und Haftungsfragen neu diskutiert werden müssen. Herausgeber sind 2026 weiterhin verantwortlich für das, was sie publizieren.

Ethik und Transparenz als Wettbewerbsvorteil

Viele Medienhäuser integrieren inzwischen Transparenzpflichten: Kennzeichnung von automatisierter Hilfe, Routinen zur Bias-Kontrolle und verpflichtende Nachbearbeitung durch Fachleute. Solche Maßnahmen dienen nicht nur der Rechtssicherheit, sie stärken auch das Vertrauen der Leserschaft.

Die zentrale Einsicht: Wer Medieninnovation vorantreibt, muss gleichzeitig klare ethische Leitplanken setzen, um die Qualität der Informationsverbreitung zu sichern.

Am Ende definieren Kontrolle, Transparenz und Ausbildung der Teams die neuen Content-Standards. Die Herausforderung bleibt, Automatisierung produktiv zu nutzen, ohne die menschliche Verantwortung für Stil, Wahrheit und Ethik aus der Hand zu geben — ein Balanceakt, der die Medienbranche auch künftig prägen wird.